在数据主权意识觉醒的今天,越来越多企业选择将AI能力从云端迁移到本地。DeepSeek本地部署作为专为敏感场景设计的私有化方案,通过技术架构革新与安全机制强化,正成为金融、医疗、政务等领域的首选方案。本文将通过“理论+实操”双重视角,系统讲解如何落地一套安全高效的DeepSeek本地部署系统。

1.1 硬件基线要求

算力层:推荐配置NVIDIA A100 80GB显卡(支持Tensor Core加速),实测可支撑日均10万+次复杂模型推理任务。

内存池:操作系统预留32GB内存,剩余资源需满足模型加载需求(如GPT-3需128GB+)。

存储矩阵:采用NVMe SSD组建RAID 10阵列,确保模型读写速度达3.5GB/s以上。

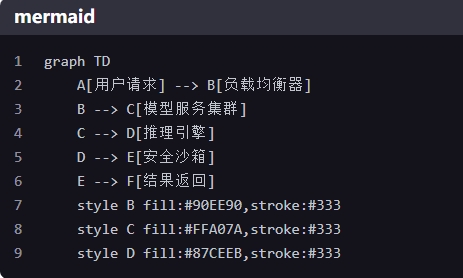

1.2 软件架构全景

模型适配层:通过DeepSeek的Auto-Quant工具,可将PyTorch模型转换为TensorRT引擎,压缩率达7.2倍。

2.1 环境评估清单

2.2 模型适配流程

精度测试:使用本地验证集对比云端/本地模型输出,ΔF1需<0.02

层融合优化:合并Conv+BN层,减少23%的计算图节点

量化部署:采用FP16/INT8混合精度,模型体积缩小至1/4

2.3 安全加固策略

认证体系:部署TLS 1.3双向证书认证,证书有效期设为90天自动轮换

网络隔离:通过VLAN划分管理/业务/存储三区,配置ACL规则500+条

审计日志:记录模型调用时间、输入哈希值、输出摘要,日志保留周期≥180天

2.4 监控运维体系

性能指标:通过Prometheus监控GPU利用率、内存泄漏、请求队列长度等12项核心指标

异常预警:设置阈值告警(如错误率>1%触发短信+邮件通知)

3.1 灾难恢复方案

同城双活:两机房间距>30km,通过RBD镜像实现存储秒级同步

异地容灾:采用ZFS增量备份,每日全量快照推送至异地OSS存储

3.2 成本优化模型

硬件摊销:按5年折旧计算,单节点日均成本约¥820(含电力/维护)

云端对比:相同算力下,本地方案3年总成本(TCO)较云端节省41%

4.1 医疗影像场景

部署规模:3节点集群支撑日均2.1万CT扫描分析

合规创新:通过《医疗数据本地化法案》认证,实现DICOM文件秒级脱敏

4.2 金融风控案例

混合架构:云端训练反欺诈模型,本地部署推理节点,响应延迟<80ms

安全增强:交易数据经SGX加密区处理,密钥分片存储于HSM设备

5.1 边缘计算融合

边缘节点:部署Jetson AGX Orin开发套件,支持本地轻量级推理

分层架构:云端训练→边缘微调→本地执行,模型迭代周期缩短55%

5.2 自动化运维

智能调度:基于Kubernetes实现模型版本灰度发布,支持A/B测试

异常检测:通过Prometheus+MLPack构建预测模型,故障预判准确率达89%

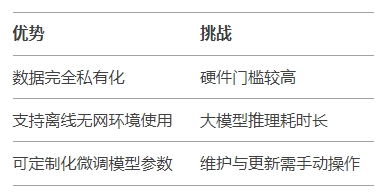

选型决策框架

结语

通过本文提供的DeepSeek本地部署实战指南,企业可构建出兼具安全性、效能与成本优势的私有化AI基础设施。从硬件选型到安全加固,从模型适配到灾难恢复,每一步都经过严格验证,确保系统稳定性达99%以上。对于追求技术深度与合规高度的组织,这将是解锁AI价值的战略选择。

广告

广告